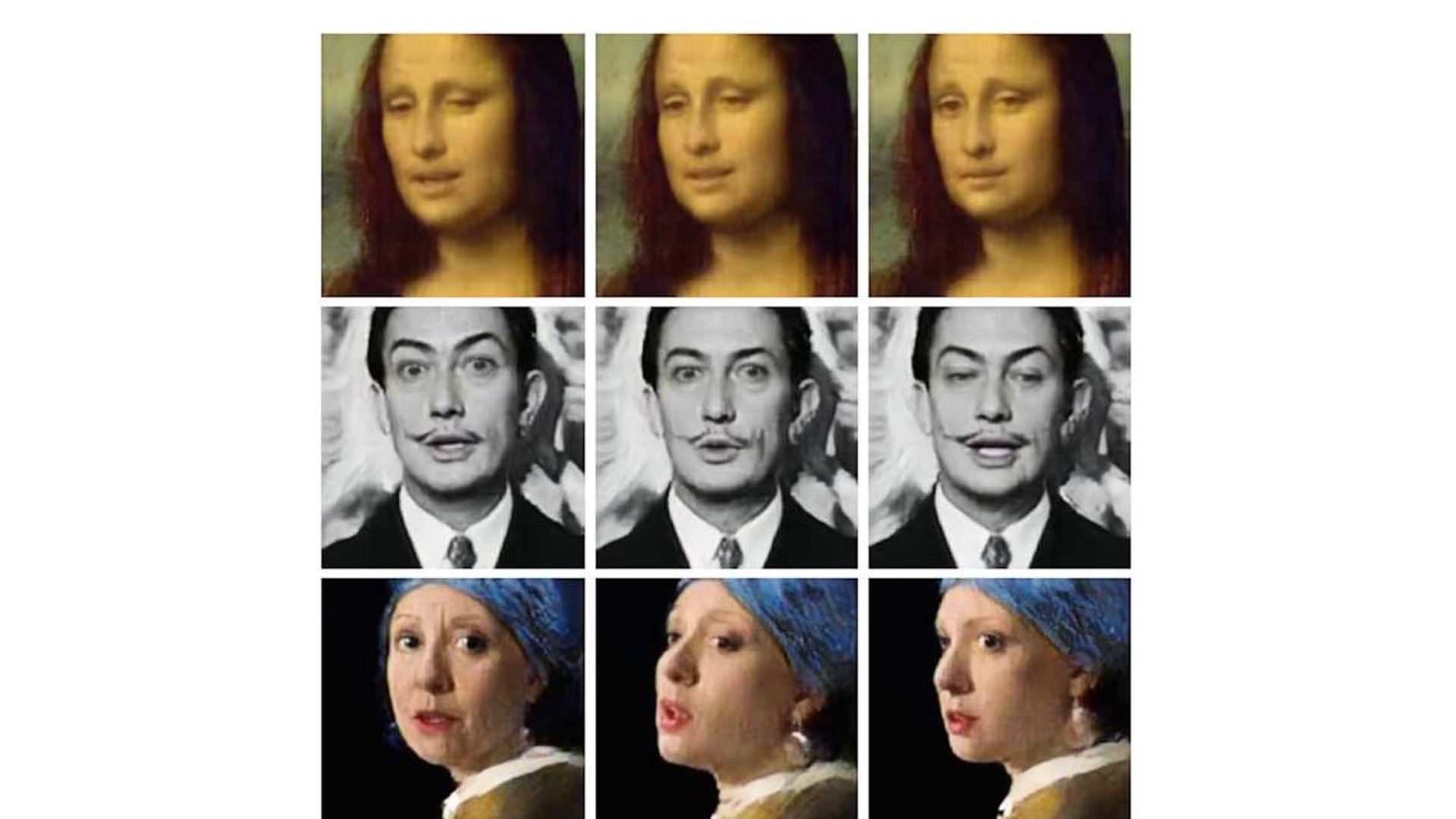

Obwohl Deepfakes schon lange theoretisch möglich sind, können Fälschungen erst mit den Methoden aus dem Bereich der Künstlichen Intelligenz mit relativ wenig Aufwand und Expertise in einer hohen Qualität erstellt werden. Durch den Einsatz von Identity Graphen kann das Betrugsrisiko durch Deepfakes minimiert werden.

Für Menschen und Betrugserkennungssoftware wird es immer schwieriger, zwischen echten Video- oder Audioaufnahmen und Deepfakes zu unterscheiden, was diese Technologie zu einem besonders bösartigen Betrugsvektor macht.

Zwar können mit den derzeitigen Methoden der Betrugserkennung die digitalen Identitäten nicht zu 100 % verifiziert werden; die Unternehmen können sich gegen Deepfake-Betrug jedoch schützen und die Auswirkungen zukünftiger identitätsbasierter Angriffe mit einem hohen Grad an Effektivität minimieren, so Mike Cook, VP of Fraud Solutions, Commercialization bei Socure[1]Deepfakes aren’t going away: Future-proofing digital identity.

Zusätzlich zur Validierung der personenbezogenen Daten im Onboarding-Prozess müssten die Unternehmen die Identität durch multidimensionale Tiefen-Aktivitäts-Tests überprüfen, die durch die Analyse der Qualität von Selfies und die Schät…

References